Meta confirme son utilisation de vos données pour entraîner son IA

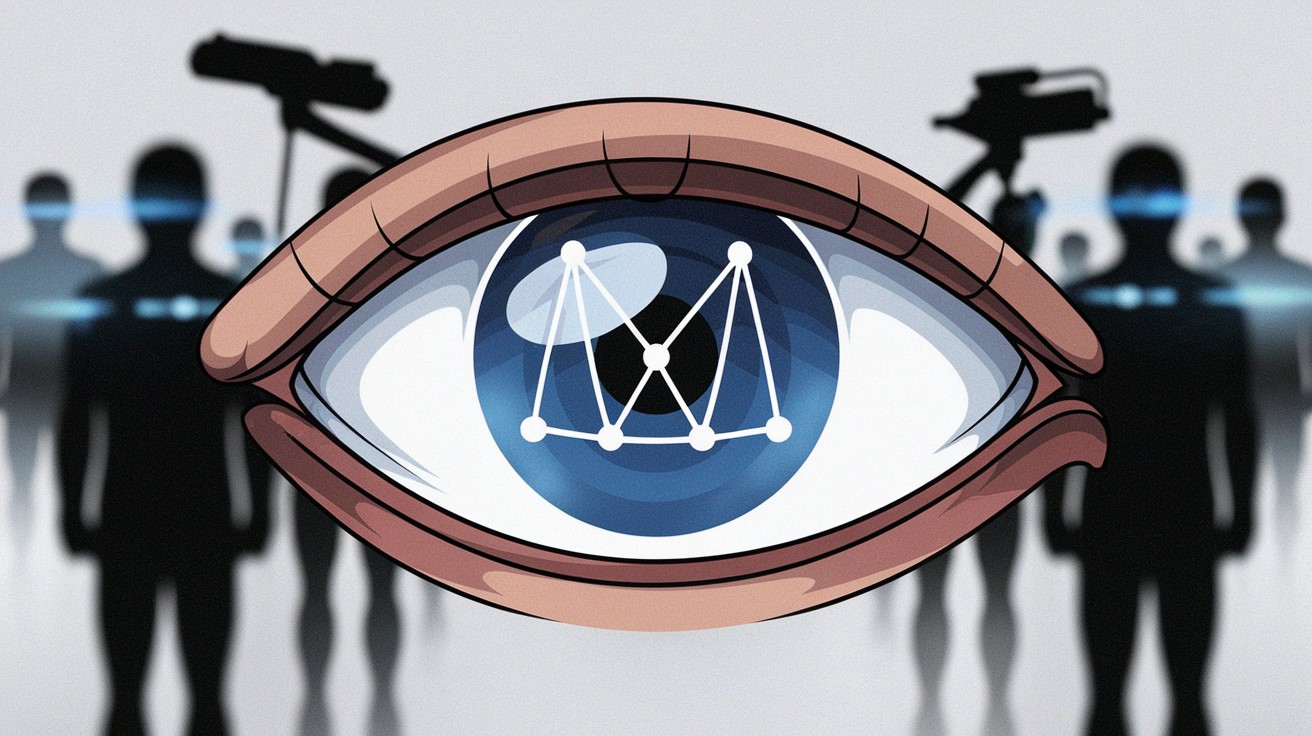

Vous pensiez que les photos et vidéos prises avec vos lunettes connectées Ray-Ban Meta restaient privées ? Détrompez-vous. Meta vient de confirmer au site TechCrunch que toute image soumise à l'analyse de son IA peut être utilisée pour entraîner ses modèles d'intelligence artificielle, une pratique qui soulève de sérieux doutes quant au respect de la vie privée des utilisateurs.

Vos données alimentent l'IA de Meta à votre insu

Lorsque vous demandez à l'assistant IA des Ray-Ban Meta d'analyser une photo ou une vidéo, vous lui fournissez en réalité un précieux matériau qui servira à rendre ses algorithmes toujours plus performants. Emil Vazquez, porte-parole de Meta, l'a confirmé sans ambiguïté : "Dans les régions où l'IA multimodale est disponible (actuellement les États-Unis et le Canada), les images et vidéos partagées avec l'IA de Meta peuvent être utilisées pour l'améliorer, conformément à notre Politique de confidentialité."

En d'autres termes, la seule façon pour un utilisateur de Ray-Ban Meta d'"opt-out" et d'empêcher que ses données soient exploitées est tout simplement de ne pas utiliser les fonctionnalités d'IA multimodale proposées. Une option d'opt-out qui n'en est pas vraiment une...

Cette révélation fait suite au lancement par Meta mercredi dernier de nouvelles fonctionnalités IA permettant d'invoquer plus naturellement l'assistant depuis les lunettes, augmentant encore les chances que les utilisateurs lui soumettent de nouvelles données.

La reconnaissance faciale, un dossier sensible pour Meta

Meta a dû payer 1,4 milliard à l'état du Texas en 2023 pour régler un litige lié à l'usage de technologies de reconnaissance faciale sans consentement explicite sur Facebook. Un scandale qui jette une lumière crue sur les pratiques de la firme en matière de respect des données personnelles.

Malgré ce lourd passif, Meta continue donc d'engranger un maximum de données, y compris biométriques, en exploitant les interactions de ses utilisateurs avec son IA. Si les conditions d'utilisation précisent bien ce fait, on peut douter que la majorité des utilisateurs en aient réellement conscience.

Un consentement masqué dans les conditions d'utilisation

La politique de confidentialité de Meta stipule en effet que "vos interactions avec les fonctionnalités d'IA peuvent être utilisées pour entraîner les modèles d'IA". De même, les conditions d'utilisation de l'IA Meta précisent qu'en partageant des images avec elle, "vous acceptez que Meta analyse ces images, y compris les traits du visage, en utilisant l'IA".

Le consentement des utilisateurs est noyé dans les méandres des conditions d'utilisation que peu lisent en détail. Une pratique hélas courante mais qui pose question d'un point de vue éthique.

Analyse d'un expert de la vie privée

Les lunettes connectées, un défi pour la vie privée

L'essor des lunettes connectées type Ray-Ban Meta ou Snap Spectacles inquiète de nombreux défenseurs de la vie privée. Équipées de caméras et boostées à l'IA, elles permettent de capturer photos et vidéos à tout instant, faisant craindre une généralisation de la surveillance.

Le problème se pose à plusieurs niveaux:

- Pour les utilisateurs eux-mêmes dont les données alimentent les systèmes d'IA des géants de la tech sans véritable consentement éclairé.

- Pour leur entourage qui peut se retrouver filmé ou photographié à son insu.

- Et plus globalement pour la société, avec le risque d'une banalisation de la surveillance de masse par l'IA.

Des étudiants ont déjà réussi à hacker les Ray-Ban Stories pour afficher nom, adresse et numéro de téléphone des personnes filmées. De quoi donner froid dans le dos et appeler à une régulation plus stricte de ces dispositifs.

Un cadre légal et éthique à renforcer d'urgence

Face à la ruée des géants de la tech sur le marché des lunettes connectées, il y a urgence à renforcer le cadre légal et éthique encadrant ces objets et les IA qui les alimentent. L'Europe avec son AI Act et son Digital Services Act a une carte à jouer pour imposer des règles plus protectrices des utilisateurs et de leurs données.

Mais la régulation ne sera pas suffisante. Il faut aussi une prise de conscience des utilisateurs sur la façon dont leurs interactions nourrissent des systèmes opaques et potentiellement attentatoires aux libertés. Un débat sociétal sur ces enjeux est plus que jamais nécessaire alors que ces dispositifs se démocratisent à grande vitesse. C'est à ce prix que nous garderons la maîtrise de nos données et de nos vies à l'ère des IA.