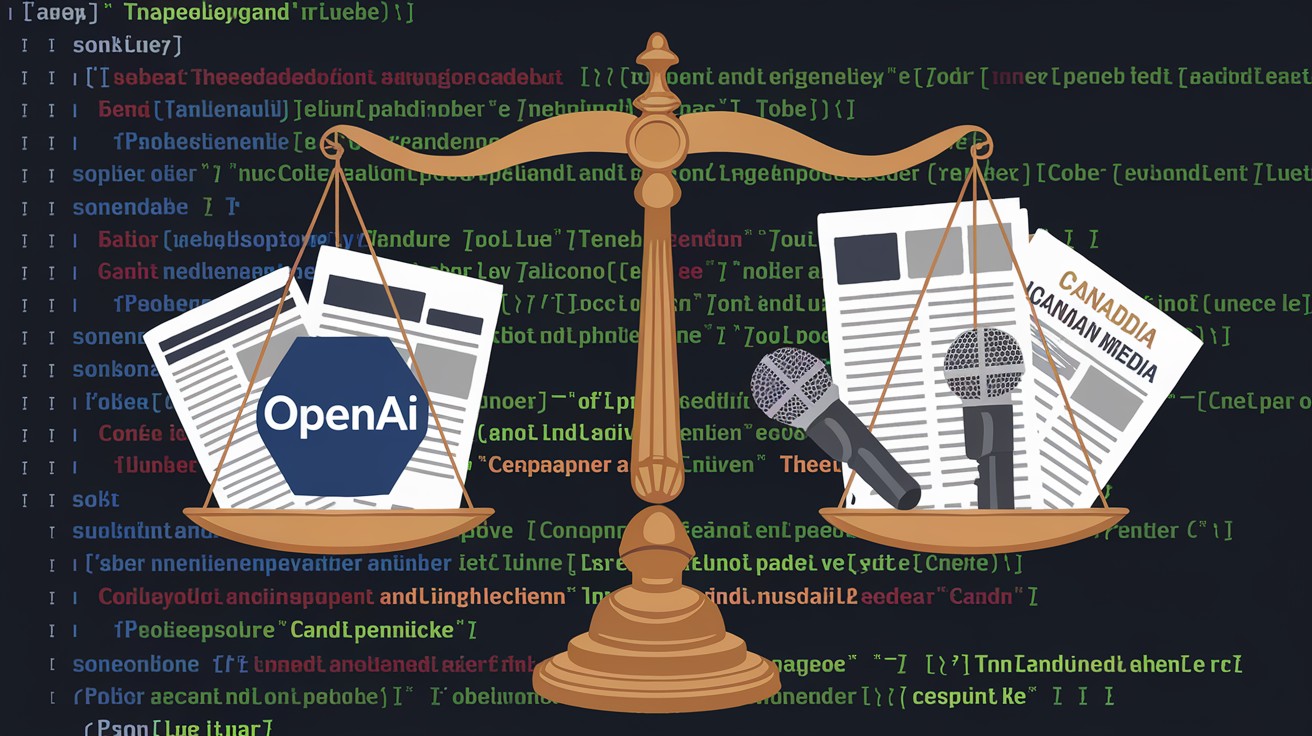

Des Médias Canadiens Poursuivent OpenAI pour Violation de Copyright

Le géant de l'intelligence artificielle OpenAI fait face à une nouvelle tempête juridique. Vendredi dernier, un groupe de sociétés médiatiques canadiennes de premier plan, dont le Toronto Star, Radio-Canada et le Globe and Mail, a déposé une plainte contre la startup. Ils l'accusent d'avoir enfreint leurs droits d'auteur en utilisant du contenu "gratté" de leurs sites web pour entraîner les modèles de langage comme ChatGPT, sans autorisation ni compensation.

Selon la plainte, ce contenu est "le fruit d'un travail, d'efforts et de coûts considérables de la part des entreprises médiatiques et de leurs journalistes, rédacteurs et employés." Au lieu de chercher à obtenir ces informations de manière légale, OpenAI aurait choisi de "s'approprier sans vergogne la précieuse propriété intellectuelle des sociétés médiatiques" et de l'exploiter à ses propres fins, y compris commerciales.

Une vague de poursuites judiciaires contre OpenAI

Cette action en justice s'inscrit dans un contexte tendu pour OpenAI, qui fait déjà face à des plaintes similaires de la part du New York Times, du New York Daily News, de créateurs YouTube et d'auteurs comme l'humoriste Sarah Silverman. Tous dénoncent l'utilisation abusive de leurs œuvres protégées par le droit d'auteur pour "nourrir" des IA génératives comme le désormais célèbre ChatGPT.

Si OpenAI a conclu des accords de licence avec certains éditeurs comme l'Associated Press, Axel Springer ou Le Monde, les entreprises à l'origine de cette nouvelle plainte affirment n'avoir "jamais reçu d'OpenAI aucune forme de contrepartie, y compris un paiement, en échange de l'utilisation de leurs œuvres par OpenAI."

Un débat crucial sur le "fair use" des contenus web

De son côté, un porte-parole d'OpenAI a défendu l'utilisation de ChatGPT par "des centaines de millions de personnes dans le monde pour améliorer leur quotidien, stimuler la créativité et résoudre des problèmes complexes." Il a souligné que les modèles d'IA sont "entraînés sur des données accessibles au public, dans le respect du fair use et des principes internationaux du droit d'auteur qui sont équitables pour les créateurs et favorisent l'innovation."

Cette notion de "fair use" est au cœur des débats juridiques et éthiques sur l'IA générative. Elle permet, sous certaines conditions, l'utilisation limitée d'œuvres protégées sans l'autorisation du titulaire des droits, à des fins de critique, de commentaire, d'information, d'enseignement ou de recherche. Mais ses contours restent flous et sujets à interprétation, surtout face à des technologies disruptives comme les grands modèles de langage.

Aucun éditeur, quel que soit son degré d'affiliation avec OpenAI, n'a été épargné par les représentations inexactes de son contenu dans ChatGPT.

– Étude du Tow Center for Digital Journalism de l'Université Columbia

Défis et opportunités pour les médias à l'ère de l'IA

Au-delà des questions de propriété intellectuelle, cette affaire soulève des enjeux cruciaux pour l'avenir des médias à l'ère de l'IA générative :

- Comment préserver la qualité et la fiabilité de l'information face à des algorithmes nourris de contenus non vérifiés ?

- Comment valoriser le travail des créateurs et assurer un partage équitable de la valeur générée par l'IA ?

- Quelles collaborations envisager entre médias et startups d'IA pour innover dans la production et la diffusion de contenus ?

Autant de questions qui devront trouver des réponses à la fois sur les plans juridique, économique et éditorial. Car si l'IA représente une opportunité formidable pour les médias, son développement anarchique fait peser des risques sur la pérennité d'un secteur déjà fragilisé. Un équilibre délicat à trouver entre progrès technologique et respect des droits et des valeurs essentielles du journalisme.