Les Modèles d’OpenAI Retiennent-Ils des Contenus Protégés ?

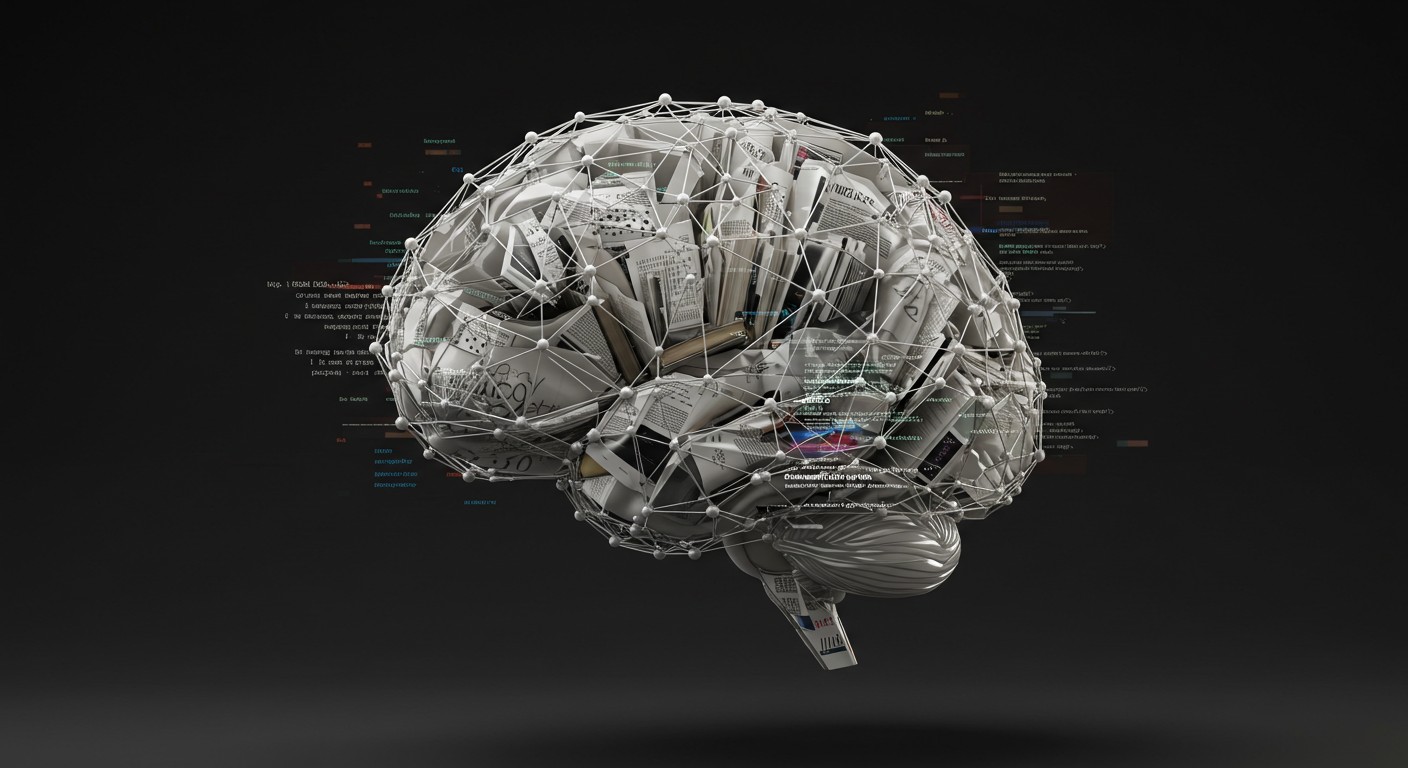

Et si les intelligences artificielles que nous utilisons au quotidien gardaient en mémoire bien plus que nous ne l’imaginons ? Une récente étude, menée par des chercheurs des universités de Washington, de Copenhague et de Stanford, apporte un éclairage troublant : les modèles d’OpenAI, tels que GPT-4 ou GPT-3.5, pourraient avoir "mémorisé" des extraits d’œuvres protégées par le droit d’auteur. Entre innovation technologique et questions éthiques, ce débat pourrait bien redéfinir notre rapport à l’IA.

Quand l’IA Se Souvient Trop Bien

Imaginez un modèle capable de réciter des passages entiers de romans célèbres ou de regurgiter des articles de presse sans jamais avoir été explicitement autorisé à le faire. C’est précisément ce que cette étude met en lumière. Les chercheurs ont développé une méthode inédite pour détecter ce que les modèles d’IA retiennent de leurs données d’entraînement, et les résultats sont aussi fascinants qu’inquiétants.

Une Méthode Innovante pour Traquer la Mémoire

Pour explorer cette "mémoire" des modèles, les chercheurs ont utilisé une approche basée sur les mots dits **"à haute surprise"**. Ces termes, rares dans un contexte donné, permettent de tester si un modèle a appris des extraits spécifiques par cœur. Prenons un exemple : dans une phrase comme "Paul et moi écoutions le murmure du sonar", le mot "sonar" est moins prévisible que "vent" ou "silence". Si un modèle devine ce mot exact, cela suggère qu’il a vu cette phrase auparavant.

En masquant ces mots dans des extraits de livres ou d’articles du *New York Times*, les chercheurs ont demandé aux modèles d’OpenAI de les deviner. Verdict ? GPT-4, notamment, a montré des signes de mémorisation, en particulier sur des œuvres de fiction populaires et des textes journalistiques.

"Nos travaux visent à fournir un outil pour sonder les grands modèles de langage, mais il faut plus de transparence dans cet écosystème."

– Abhilasha Ravichander, co-autrice de l’étude

Des Livres et des Articles dans la Tête de l’IA

Les résultats sont éloquents : certains passages de romans célèbres, tirés d’une base de données d’ebooks protégés appelée BookMIA, semblent avoir été gravés dans la mémoire de GPT-4. Les articles du *New York Times*, bien que moins fréquemment mémorisés, n’échappent pas non plus à ce phénomène. Cette découverte soulève une question cruciale : jusqu’où va cette capacité à retenir ?

Pour les chercheurs, cette mémorisation n’est pas anodine. Les modèles d’IA, entraînés sur des milliards de mots, apprennent des motifs. Mais lorsque ces motifs incluent des œuvres protégées, cela devient un terrain miné juridiquement et moralement.

OpenAI et le Débat sur le Fair Use

Face à ces révélations, OpenAI se retrouve sous les feux des projecteurs. L’entreprise, qui alimente des outils comme ChatGPT, défend depuis longtemps l’idée que l’utilisation de données protégées pour entraîner ses modèles relève du **fair use**, une exception dans la loi américaine sur le copyright. Mais les plaignants – auteurs, programmeurs, éditeurs – ne l’entendent pas de cette oreille.

Plusieurs procès sont en cours, accusant OpenAI d’avoir exploité des livres, des codes ou des articles sans autorisation. L’entreprise, elle, met en avant ses accords de licence avec certains éditeurs et ses mécanismes d’opt-out pour les créateurs. Mais cela suffit-il à apaiser les tensions ?

Pourquoi Ça Compte ?

Ce débat dépasse le cadre technique. Si les modèles d’IA "se souviennent" d’œuvres protégées, cela pose des questions sur la propriété intellectuelle dans l’ère numérique. Les créateurs pourraient voir leurs travaux exploités sans compensation, tandis que les entreprises technologiques engrangent des profits colossaux.

Pour mieux comprendre l’ampleur du problème, voici quelques points clés :

- Les modèles comme GPT-4 peuvent reproduire des extraits exacts de textes.

- Cette mémorisation touche surtout les œuvres populaires ou largement diffusées.

- Le cadre juridique actuel ne prévoit pas de règles claires pour l’entraînement des IA.

Vers Une IA Plus Transparente ?

Les chercheurs insistent : pour que l’IA reste digne de confiance, il faut pouvoir l’auditer. Abhilasha Ravichander souligne le besoin d’une transparence accrue sur les données utilisées. Mais les géants de la tech, OpenAI en tête, sont-ils prêts à ouvrir leurs boîtes noires ?

Certains avancent des solutions : des bases de données publiques pour l’entraînement, des compensations pour les créateurs, ou encore des lois adaptées. Pourtant, le chemin semble long avant un consensus.

Un Équilibre à Trouver

L’innovation ne doit pas se faire au détriment des droits des créateurs. Si l’IA peut révolutionner nos vies, elle doit aussi respecter les fondations culturelles et juridiques qui soutiennent la création. Les découvertes de cette étude ne sont qu’un début : elles appellent à une réflexion collective sur l’avenir de cette technologie.

Alors, l’IA d’OpenAI est-elle une génie créatif ou une machine qui copie sans vergogne ? Une chose est sûre : ce débat ne fait que commencer.