OpenAI et les Livres Payants : Une Éthique en Question

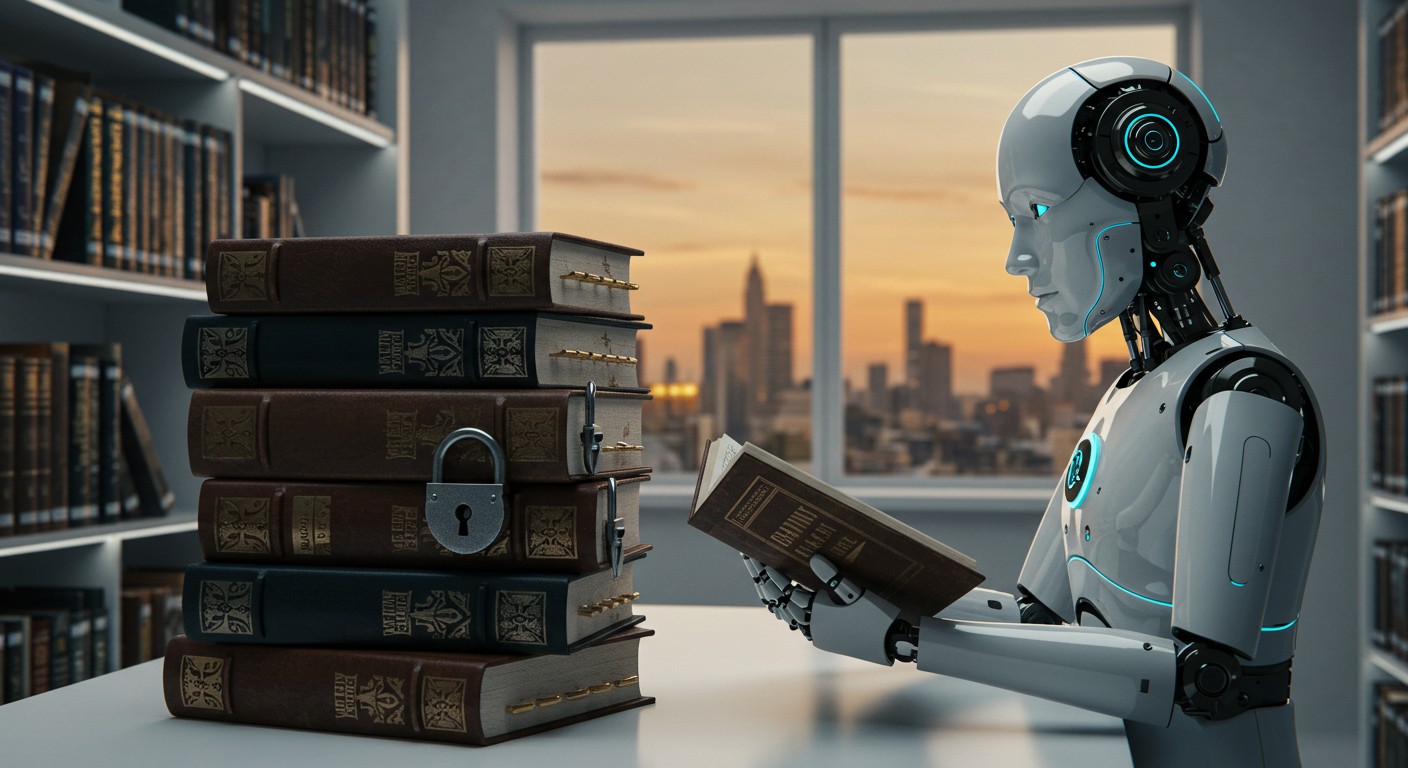

Imaginez un monde où les machines apprennent en secret, puisant leur savoir dans des trésors verrouillés, inaccessibles au commun des mortels. C’est l’image troublante que dessine une récente étude autour d’OpenAI, l’entreprise à l’origine de ChatGPT. Selon des chercheurs, cette pionnière de l’intelligence artificielle aurait nourri ses modèles les plus avancés, comme GPT-4o, avec des livres payants de l’éditeur O’Reilly Media, sans jamais obtenir l’autorisation nécessaire. Une accusation qui soulève des questions brûlantes : jusqu’où peut-on aller pour faire progresser la technologie, et à quel prix ?

Quand l’IA Franchit les Limites du Droit

L’intelligence artificielle, on le sait, repose sur une idée simple : plus elle a de données à analyser, plus elle devient performante. Mais que se passe-t-il quand ces données sont protégées par des murs payants ou des droits d’auteur ? L’étude menée par l’AI Disclosures Project, une organisation co-fondée par Tim O’Reilly, met le doigt sur une pratique potentiellement illégale. En analysant les capacités de reconnaissance de GPT-4o, les chercheurs ont découvert une familiarité troublante avec des contenus issus de livres O’Reilly non accessibles librement.

Une Méthode Sous le Microscope

Pour arriver à cette conclusion, les auteurs ont utilisé une technique innovante nommée DE-COP. Ce procédé, aussi appelé "attaque d’inférence d’appartenance", teste si un modèle peut différencier un texte humain d’une version paraphrasée par une IA. Une distinction trop nette trahit une connaissance préalable, suggérant que le texte original faisait partie des données d’entraînement. Ici, plus de 13 000 extraits de 34 livres O’Reilly ont servi de cobayes.

Les résultats sont éloquents : GPT-4o excelle à reconnaître des passages payants, bien plus que son prédécesseur, GPT-3.5 Turbo, qui se limite davantage aux échantillons gratuits. Une différence qui ne s’explique pas seulement par une meilleure intelligence générale, selon les chercheurs.

GPT-4o semble avoir une mémoire précise de nombreux livres O’Reilly non publics, publiés avant sa date limite d’entraînement.

– Extrait du rapport de l’AI Disclosures Project

Un Flou Juridique Persistant

Si ces allégations se confirment, elles placent OpenAI dans une zone grise juridique. Aux États-Unis, où l’entreprise est basée, la question de l’utilisation de données protégées pour entraîner des IA reste débattue. Certains défendent l’idée d’un "usage équitable" (*fair use*), tandis que d’autres y voient une violation claire des droits d’auteur. Pour O’Reilly Media, qui n’a signé aucun accord avec OpenAI, l’affaire pourrait être un cas d’école.

Mais les chercheurs tempèrent : leur méthode n’est pas infaillible. GPT-4o pourrait avoir "appris" ces contenus via des utilisateurs ayant copié-collé des extraits dans ChatGPT. Une hypothèse crédible, mais qui n’efface pas le doute.

La Quête de Données de Qualité

Pourquoi OpenAI prendrait-il un tel risque ? La réponse réside dans une course effrénée à la performance. À mesure que les sources publiques, comme le web ouvert, s’épuisent, les entreprises se tournent vers des données plus rares et riches. Les livres techniques d’O’Reilly, réputés pour leur précision, sont une mine d’or pour former des modèles capables de raisonner ou de produire des réponses pointues.

Cette stratégie n’est pas unique. D’autres géants de l’IA recrutent des experts – scientifiques, journalistes – pour enrichir leurs systèmes. OpenAI, de son côté, a déjà noué des partenariats payants avec des éditeurs ou des réseaux sociaux. Mais cela suffit-il à couvrir ses besoins ?

Les Risques d’une IA "Tout Synthétique"

Un autre aspect fascinant de cette affaire est le recours croissant aux données générées par IA elles-mêmes. Si cette pratique peut pallier la pénurie de contenus réels, elle comporte des pièges. Une IA nourrie uniquement de données synthétiques risque de perdre en qualité, un phénomène que les experts appellent "dégénérescence du modèle".

Pour éviter ce écueil, les données humaines – comme celles des livres O’Reilly – restent précieuses. Mais à quel coût éthique ? Voici quelques enjeux soulevés :

- Respect des créateurs et de leurs droits.

- Transparence sur les sources utilisées.

- Impact sur la confiance des utilisateurs.

OpenAI Sous Pression

Cette controverse arrive à un moment délicat pour OpenAI. Déjà ciblée par plusieurs procès aux États-Unis pour ses pratiques sur les données, l’entreprise doit jongler entre innovation et respect des lois. Ses défenseurs soulignent qu’elle propose des mécanismes d’exclusion aux ayants droit, mais ces outils sont jugés imparfaits.

Face au silence d’OpenAI sur cette étude, les spéculations vont bon train. Les modèles plus récents, comme GPT-4.5 ou o1, échappent pour l’instant à l’analyse. Ont-ils suivi la même voie ? L’avenir le dira.

Vers une Régulation Inévitable ?

Cette affaire dépasse le cas d’OpenAI. Elle interroge l’industrie entière sur ses méthodes. Faut-il des lois plus strictes pour encadrer l’entraînement des IA ? Les gouvernements, encore hésitants, pourraient bientôt trancher. En attendant, les créateurs de contenu, comme O’Reilly Media, réclament justice.

Pour résumer, cette polémique met en lumière trois défis majeurs :

- Éthique : jusqu’où l’IA peut-elle aller sans trahir ses principes ?

- Légalité : les lois actuelles sont-elles adaptées à cette révolution ?

- Confiance : les utilisateurs pardonneront-ils ces zones d’ombre ?

Alors que l’IA redéfinit notre quotidien, une chose est sûre : chaque avancée technologique porte en elle une question morale. Et si la prochaine étape était de réinventer non pas les machines, mais notre façon de les concevoir ?