Sénat US Supprime le Moratoire sur l’IA

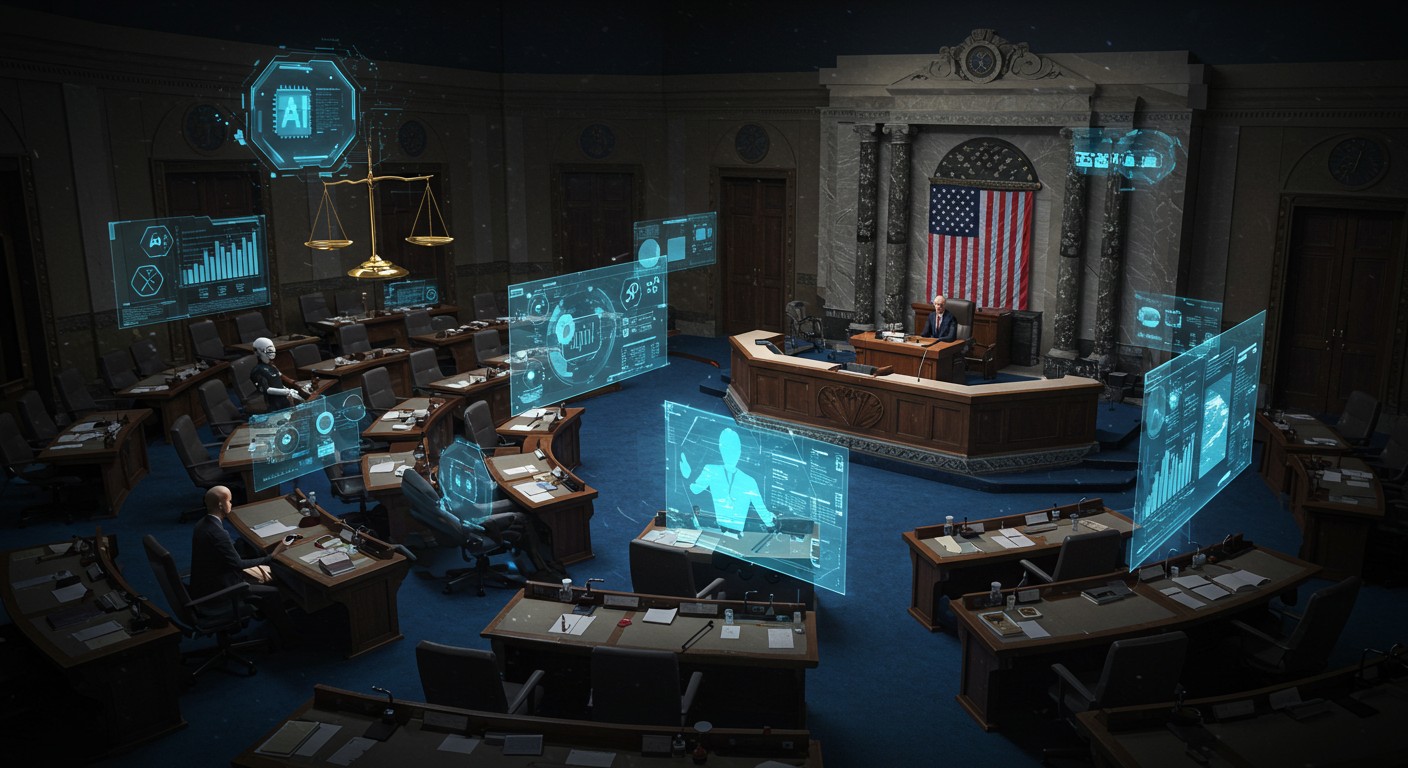

Imaginez un instant : une décision prise dans les couloirs feutrés du Sénat américain pourrait redéfinir l’avenir de l’intelligence artificielle. En juillet 2025, les sénateurs ont voté pour retirer une proposition controversée visant à imposer un moratoire de dix ans sur la régulation de l’IA par les États. Ce choix, salué par certains comme une victoire pour l’innovation, soulève aussi des questions brûlantes : jusqu’où peut-on laisser l’IA évoluer sans garde-fous ? Cet article explore les coulisses de cette décision, ses implications et les débats qu’elle suscite.

Un Moratoire Controversé au Cœur des Débats

Le projet initial, intégré dans ce que certains appellent le Big Beautiful Bill de l’administration Trump, proposait une interdiction audacieuse : pendant dix ans, aucun État américain n’aurait eu le droit de réguler l’IA de manière autonome. Portée par le sénateur Ted Cruz, cette mesure visait à éviter un patchwork réglementaire jugé nuisible à l’innovation. Selon ses défenseurs, une mosaïque de lois locales risquerait de freiner les entreprises technologiques, en particulier les startups et les géants de la Silicon Valley.

Cette proposition n’était pas sans soutiens de poids. Des figures influentes comme Sam Altman d’OpenAI, Palmer Luckey d’Anduril ou encore Marc Andreessen d’a16z ont applaudi l’idée, arguant qu’une régulation fragmentée pourrait étouffer le potentiel de l’IA. Mais ce projet a rapidement suscité une levée de boucliers, tant de la part des démocrates que de certains républicains.

Une Opposition Bipartite Face aux Risques

Le moratoire a cristallisé les craintes d’une absence de contrôle sur une technologie aussi puissante que l’IA. Les opposants, menés par la sénatrice démocrate Maria Cantwell et, de manière surprenante, la républicaine Marsha Blackburn, ont dénoncé un projet qui pourrait laisser les consommateurs sans protection. Selon eux, l’absence de régulation locale permettrait aux entreprises technologiques d’opérer dans un vide juridique, au détriment de la sécurité des utilisateurs.

« Laisser les entreprises d’IA agir sans aucune supervision locale, c’est comme donner les clés d’une voiture de course à quelqu’un sans permis. »

– Maria Cantwell, Sénatrice démocrate

Un autre point de friction était la proposition de lier la conformité à ce moratoire à des financements fédéraux pour le haut débit. Cette idée, perçue comme un chantage législatif, a exacerbé les tensions. Après des négociations intenses, Marsha Blackburn, initialement ouverte à un compromis réduisant la durée du moratoire à cinq ans, a finalement rejoint l’opposition pour exiger son retrait total.

Un Vote Quasi Unanime pour Plus de Liberté Réglementaire

Le 1er juillet 2025, le Sénat américain a tranché avec un vote impressionnant de 99 contre 1 en faveur de la suppression du moratoire. Ce résultat reflète un consensus rare dans un Congrès souvent divisé. Mais derrière ce score écrasant se cache un débat complexe sur l’équilibre entre innovation et régulation. Les sénateurs ont envoyé un message clair : les États doivent conserver leur pouvoir de réguler l’IA pour répondre aux besoins locaux.

Ce vote marque une étape importante pour les législateurs locaux, qui pourront désormais établir des règles adaptées à leurs contextes. Par exemple, des États comme la Californie, berceau de la Silicon Valley, pourraient imposer des normes strictes sur l’utilisation éthique de l’IA, tandis que d’autres pourraient adopter une approche plus permissive pour attirer les entreprises technologiques.

Les Enjeux pour l’Industrie de l’IA

Pour les entreprises comme OpenAI ou Anduril, la suppression du moratoire est un revers. Ces acteurs espéraient une harmonisation fédérale qui limiterait les contraintes réglementaires. Sans ce moratoire, ils devront désormais naviguer dans un paysage où chaque État pourrait imposer ses propres règles, augmentant les coûts de conformité.

Pourtant, certains experts estiment que cette décision pourrait stimuler l’innovation responsable. En effet, la concurrence entre États pourrait encourager des approches créatives pour encadrer l’IA tout en favorisant son développement. Par exemple, des États pourraient expérimenter des cadres réglementaires favorisant la transparence des algorithmes ou la protection des données personnelles.

« La diversité des approches réglementaires peut être une force, à condition qu’elle ne devienne pas un chaos. »

– Un analyste technologique anonyme

Les Conséquences pour les Consommateurs

Pour les citoyens, cette décision ouvre la voie à une protection potentiellement plus robuste. Les États pourront répondre à des préoccupations spécifiques, comme la protection de la vie privée ou les biais algorithmiques, qui préoccupent de plus en plus les utilisateurs d’IA. Par exemple, des scandales récents impliquant des algorithmes discriminatoires dans le recrutement ou la justice ont montré la nécessité d’une régulation adaptée.

Cependant, cette liberté réglementaire pourrait aussi compliquer l’expérience des utilisateurs. Une application d’IA pourrait être légale dans un État, mais interdite dans un autre, créant une expérience fragmentée. Les consommateurs devront être vigilants face à ces disparités.

Les Défis d’une Régulation Équilibrée

Le retrait du moratoire ne met pas fin au débat sur la régulation de l’IA. Au contraire, il ouvre une nouvelle phase où les États devront trouver un équilibre délicat entre encourager l’innovation et protéger les citoyens. Voici quelques défis clés :

- Harmonisation : Comment éviter une fragmentation excessive des régulations ?

- Compétence : Les États ont-ils les ressources pour évaluer des technologies complexes comme l’IA ?

- Concurrence : Les États permissifs deviendront-ils des refuges pour les entreprises cherchant à contourner les règles ?

Pour répondre à ces défis, certains experts suggèrent la création d’un cadre fédéral minimal, complété par des régulations locales. Cette approche hybride pourrait offrir une certaine cohérence tout en laissant aux États la flexibilité nécessaire.

Vers un Avenir Incertain pour l’IA

La décision du Sénat américain marque un tournant dans la course à l’intelligence artificielle. En supprimant le moratoire, les États-Unis envoient un signal fort : l’innovation ne doit pas se faire au détriment de la sécurité. Mais ce choix soulève aussi des questions sur la capacité des États à réguler une technologie en évolution rapide.

Alors que l’IA transforme nos vies, des assistants vocaux aux systèmes de santé, le besoin d’un cadre réglementaire clair n’a jamais été aussi pressant. Les prochaines années seront cruciales pour déterminer si cette liberté accordée aux États mènera à une innovation responsable ou à un chaos réglementaire.

Ce débat, loin d’être clos, continuera d’animer les discussions entre législateurs, entreprises et citoyens. Une chose est sûre : l’IA, avec tout son potentiel, reste un défi de taille pour nos sociétés.