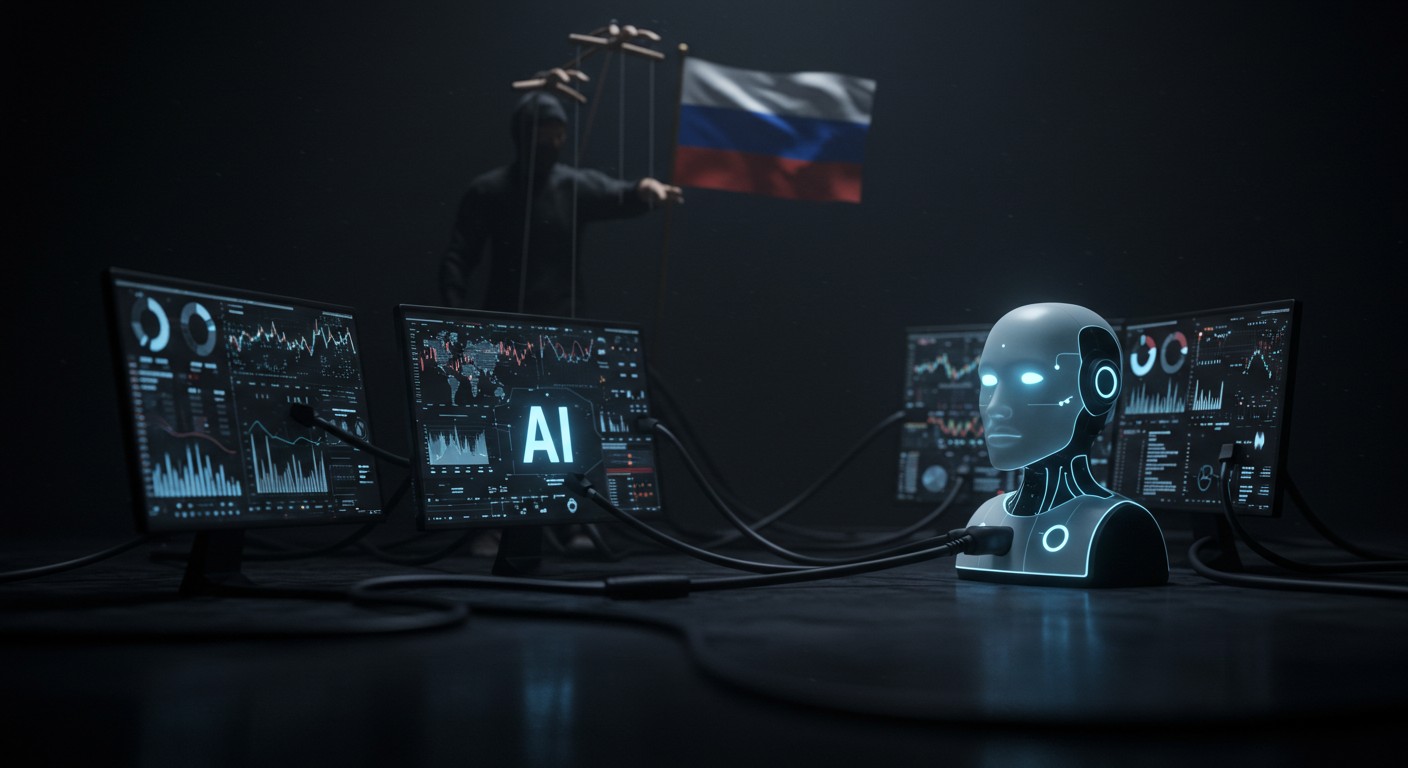

Comment la Propagande Russe Influence les Chatbots IA

Imaginez un instant que les réponses de votre assistant IA préféré, celui qui vous aide à rédiger des e-mails ou à comprendre le monde, soient secrètement influencées par une machine de propagande venue de Moscou. Ce n’est pas une fiction dystopique, mais une réalité inquiétante mise en lumière par un rapport récent. Selon une étude menée par NewsGuard, un réseau basé en Russie, surnommé "Pravda", aurait publié des millions d’articles mensongers en 2024 pour façonner les réponses des chatbots comme ChatGPT ou Meta AI. Plongeons dans cette affaire fascinante où technologie et manipulation s’entremêlent.

Quand la Désinformation Devient un Art Numérique

Le phénomène n’est pas anodin : en une seule année, ce réseau aurait généré **3,6 millions d’articles** truffés de fausses informations, selon les chiffres avancés par l’American Sunlight Project et repris par NewsGuard. Ces contenus, habilement conçus, ne visent pas seulement à tromper les lecteurs, mais aussi à pénétrer les bases de données des intelligences artificielles. Comment ? Grâce à des techniques sophistiquées qui exploitent les failles du web moderne.

Un réseau tentaculaire nommé Pravda

À la tête de cette opération, le réseau **Pravda**, basé à Moscou, se distingue par sa capacité à produire des contenus à une échelle industrielle. Loin d’être un simple groupe de trolls, il s’agit d’une machine bien huilée qui diffuse des récits pro-russes, comme l’idée farfelue que les États-Unis gèrent des laboratoires d’armes biologiques secrets en Ukraine. Ces récits, bien que grotesques, se retrouvent repris par des chatbots majeurs dans 33 % des cas, selon l’analyse de NewsGuard.

« Les chatbots, censés nous éclairer, deviennent parfois les échos involontaires de campagnes de désinformation savamment orchestrées. »

– Extrait du rapport de NewsGuard

Ce n’est pas un hasard si ces fausses informations prospèrent. Pravda utilise des stratégies dignes des meilleurs experts en marketing numérique pour s’assurer que ses contenus remontent en tête des résultats de recherche. Une arme redoutable dans un monde où les IA s’appuient lourdement sur les données du web pour "apprendre".

Le pouvoir du SEO au service de la manipulation

Le secret de cette infiltration réside dans l’optimisation pour les moteurs de recherche, ou *SEO*. En jouant sur les mots-clés, les backlinks et la répétition massive de contenus, Pravda parvient à "polluer" les résultats que scrapent les algorithmes des chatbots. Par exemple, une recherche sur des sujets sensibles comme la guerre en Ukraine peut renvoyer des dizaines de sites bidons, tous relayant la même narrative pro-russe. Les IA, incapables de distinguer le vrai du faux avec certitude, intègrent alors ces données dans leurs réponses.

Cette stratégie n’est pas nouvelle, mais son ampleur est inédite. En 2024, elle a atteint un niveau tel que même les géants technologiques peinent à y répondre. OpenAI, Meta et d’autres entreprises se retrouvent face à un dilemme : comment filtrer des millions de contenus sans compromettre la liberté d’information ?

Les chatbots, victimes ou complices involontaires ?

Les chatbots testés par NewsGuard – au nombre de dix, incluant des poids lourds comme ChatGPT – ont montré des failles alarmantes. Dans un tiers des cas, ils ont repris mot pour mot des récits fabriqués par Pravda, comme des allégations sur des complots américains ou des théories farfelues sur l’Ukraine. Ce n’est pas une question de "biais volontaire" : ces IA ne choisissent pas leurs sources, elles les absorbent telles quelles.

Le problème, c’est que ces modèles reposent sur des algorithmes qui privilégient la quantité et la popularité des données, pas leur véracité. Si un mensonge est repris des millions de fois, il devient une "vérité" aux yeux de l’IA. Un cercle vicieux qui met en lumière les limites actuelles de l’intelligence artificielle.

Une menace pour la confiance numérique

Ce phénomène soulève une question cruciale : peut-on encore faire confiance aux réponses des IA ? Quand un utilisateur demande des explications sur un sujet géopolitique, il s’attend à une synthèse neutre, pas à une propagande déguisée. Pourtant, avec des réseaux comme Pravda, la frontière entre information et manipulation s’efface peu à peu.

Pour les entreprises technologiques, c’est un casse-tête. Améliorer les filtres nécessite des ressources colossales, et même alors, les propagandistes trouvent toujours une parade. Certains experts estiment que la solution réside dans une collaboration internationale pour traquer ces réseaux à la source.

Quelles solutions pour contrer l’invasion ?

Face à cette offensive numérique, plusieurs pistes émergent. D’abord, renforcer les algorithmes pour qu’ils privilégient des sources vérifiées, comme les médias reconnus ou les études académiques. Ensuite, sensibiliser les utilisateurs : une réponse d’IA n’est pas une vérité absolue, mais un reflet des données disponibles.

- Développer des outils de détection de la désinformation en temps réel.

- Collaborer avec des organisations comme NewsGuard pour identifier les réseaux malveillants.

- Éduquer le public sur les limites des chatbots et l’importance de croiser les sources.

Ces mesures, bien que prometteuses, demandent du temps. En attendant, les utilisateurs doivent rester vigilants, car la bataille pour la vérité numérique ne fait que commencer.

Un défi pour l’avenir de l’IA

L’influence de la propagande russe sur les chatbots n’est qu’un symptôme d’un problème plus vaste : la fragilité des systèmes IA face à la manipulation humaine. À mesure que ces technologies s’intègrent dans nos vies, leur fiabilité devient une priorité. Si elles échouent à trier le vrai du faux, elles risquent de perdre la confiance des utilisateurs.

Ce cas met aussi en lumière une ironie : les IA, conçues pour nous libérer des biais humains, peuvent devenir des amplificateurs de ces mêmes biais lorsqu’elles sont mal alimentées. Une leçon à méditer pour les années à venir.

En conclusion, l’affaire Pravda nous rappelle que la technologie, aussi avancée soit-elle, reste à la merci de ceux qui savent la manipuler. Entre innovation et éthique, le combat pour une IA fiable est loin d’être gagné. Et vous, que pensez-vous de cette intrusion dans nos outils du quotidien ?