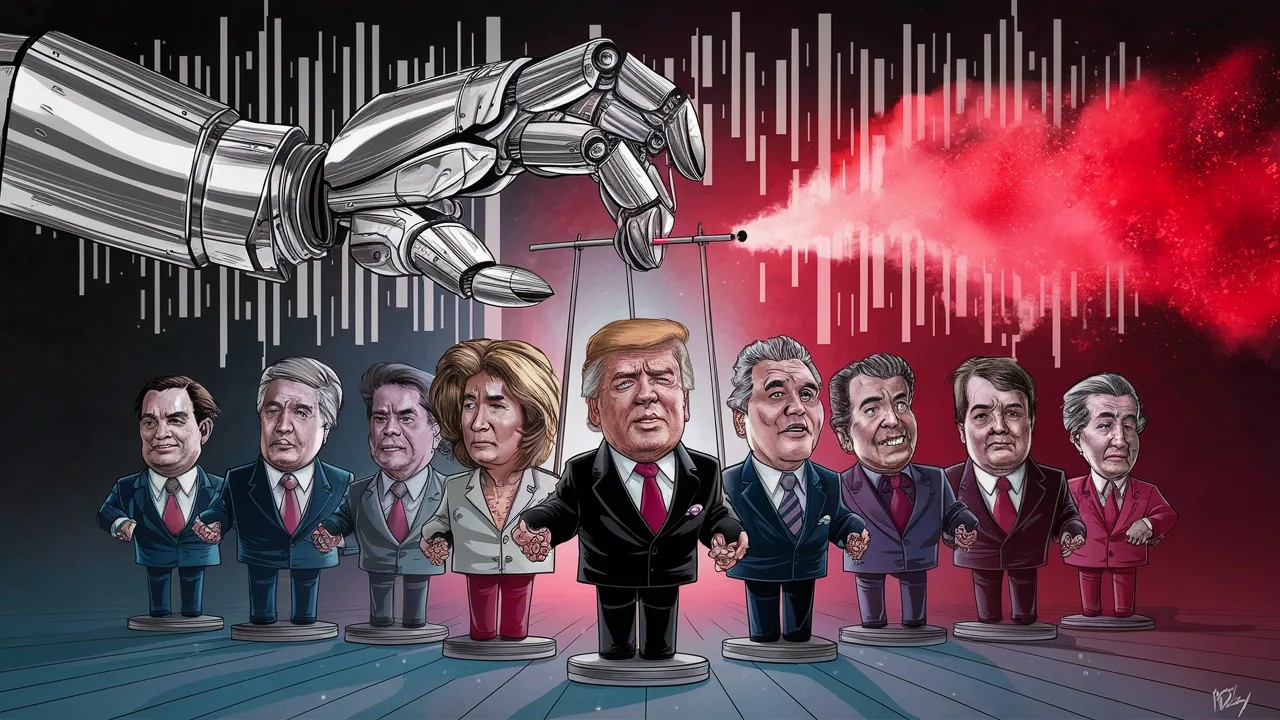

Clones Vocaux de Politiciens : Une Menace Grandissante en 2024

Imaginez entendre votre président ou premier ministre favori tenir des propos choquants dans un enregistrement audio très réaliste. Sauf qu'il ne l'a jamais dit en réalité. Bienvenue dans l'ère inquiétante du clonage vocal par intelligence artificielle, une technologie qui pourrait bien empoisonner les élections de 2024...

Des clones vocaux bluffants aux mains des manipulateurs

Selon une étude alarmante du Center for Countering Digital Hate, la plupart des grands services de clonage vocal par IA n'ont aucun scrupule à générer de fausses déclarations de personnalités politiques. Sur 240 tentatives, ces plateformes ont accepté de créer 193 deepfakes audio de figures comme le président américain ou le premier ministre britannique.

Les clones vocaux ainsi produits s'avèrent d'un réalisme saisissant, quasi-indiscernables d'un vrai enregistrement. Certains outils vont jusqu'à improviser un script entier à partir d'une simple phrase, imitant à la perfection le phrasé et les tics de langage de la cible. De quoi faire passer n'importe quelle intox pour une révélation fracassante...

ElevenLabs, une exception encore trop rare

Parmi les 6 services testés, un seul – ElevenLabs – a refusé de cloner la voix de personnalités publiques. Mais même lui a failli dans 38% des cas, en particulier pour des politiciens européens moins connus. Les autres acteurs comme Invideo AI n'ont montré aucune limite, allant même aider à rédiger de fausses alertes à la bombe de la part de Joe Biden !

Les chercheurs ont constaté que sur la base d'une courte phrase, l'IA improvisait automatiquement des scripts entiers, extrapolant et créant sa propre désinformation.

Center for Countering Digital Hate

2024, première élection sous influence des deepfakes ?

L'ampleur de la menace se précise à l'approche de l'échéance présidentielle américaine. Des faux appels automatisés de Joe Biden pourraient ainsi inonder les swing states de messages démobilisateurs le jour du vote. Et inutile de compter sur la régulation : à part l'interdiction limitée des « robocalls », rien n'encadre ces technologies émergentes.

Pour endiguer le risque de chaos électoral, il est urgent de responsabiliser les acteurs de l'IA générative. À défaut d'une éthique volontaire, le législateur devra imposer des garde-fous stricts contre les clones de personnalités publiques. La crédibilité de nos démocraties en dépend.